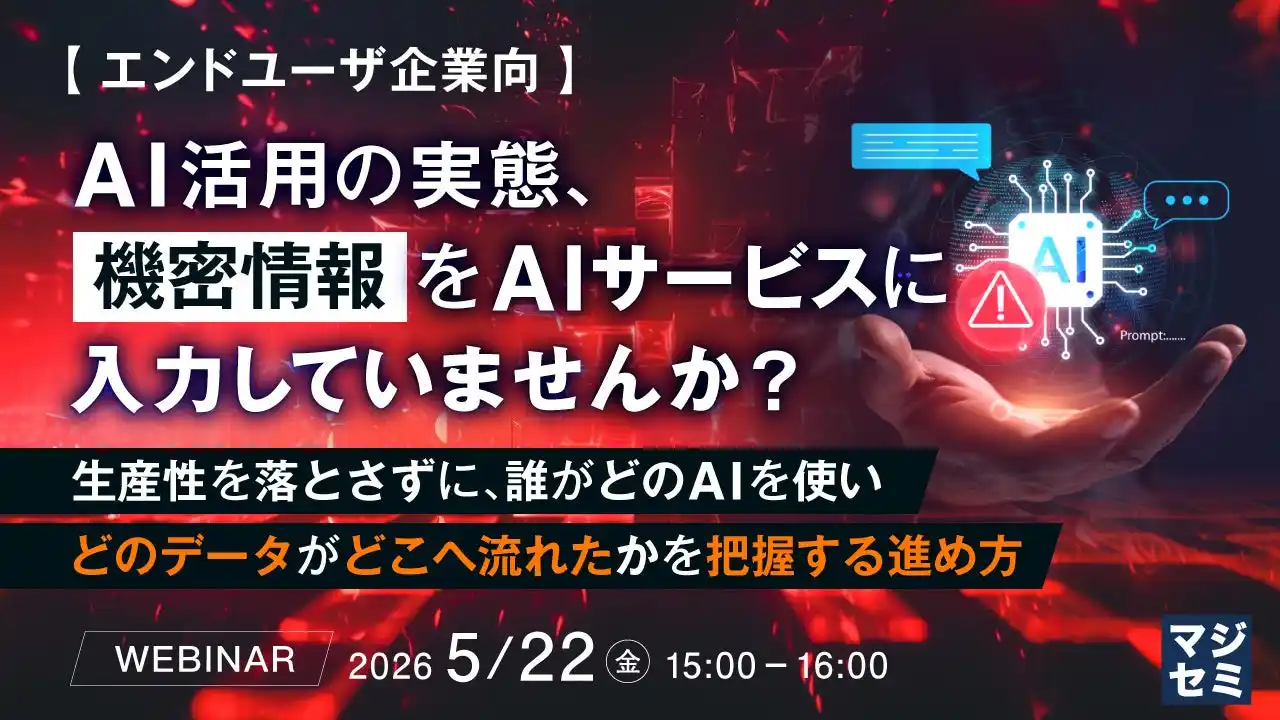

| マジセミ株式会社は「【エンドユーザ企業向】AI活用の実態、機密情報をAIサービスに入力していませんか?」というテーマのウェビナーを開催します。 |

|

|||||

|

|||||

|

■生成AI/AIエージェントの利用拡大で、アタックサーフェスとデータ流出リスクが静かに増大 生成AIやAIエージェントの活用は、個人単位の業務効率化から部門横断の業務改革へと急速に広がっています。一方で、その導入はIT部門の統制を待たずに現場主導で進みやすく、チャット型AIや自動化ツールに業務データを入力・連携する行為が日常化しています。 便利さの裏側で、機密情報や個人情報、顧客情報が意図せず外部サービスへ渡るリスク、またAI連携を起点とした新たな攻撃経路の増加が静かに進行している点は見過ごせません。従来の「アプリを承認してから使わせる」前提では追いつかない中で、AI利用を前提にした新しい可視化と統制の在り方が求められています。 ■利用実態が把握できず、ガードレールもなく「何を禁止・是正すべきか」優先順位が付けられない しかし現場では、どの部署がどのAIサービスを使っているのか、どのデータが入力・送信されているのか、といった利用実態を把握できていないケースが少なくありません。ガイドラインやルールを整備しても、実際の利用状況が見えなければ、何を禁止・是正すべきかの優先順位が付けられず、対応が「全禁止」か「放置」の両極端になりがちです。 加えて、AIサービスの種類や利用経路が多様化するほど、部門ごとの判断で例外運用が増え、統制の一貫性が崩れます。その結果、リスクが高い利用パターンを取りこぼしたまま運用が固定化し、いざ問題が起きた際に、原因の特定や影響範囲の把握に時間がかかるという課題につながります。 ■AI利用を継続検出し、機密データ露出と攻撃経路を文脈化して、対処すべきリスクを特定・抑止する 本セミナーでは、生成AI/AIエージェントの利用を前提に、業務の生産性を落とさずに「誰がどのAIを使い、どのデータがどこへ流れたか」を継続的に把握し、対処すべきリスクを特定して抑止するための考え方と進め方を解説します。 具体的には、AI利用の検出と可視化を起点に、機密データの露出リスクや攻撃経路の可能性を文脈化し、是正すべき対象を絞り込む手順を整理します。あわせて、ガードレールの設計(ルール・運用・例外管理)をどの粒度で整備すべきか、現場と合意形成しながら段階的に適用範囲を広げるポイントを紹介し、AI活用を止めずにリスクをコントロールする実践的なヒントをお伝えします。 ■主催・共催 Tenable Network Security Japan 株式会社 ■協力 株式会社オープンソース活用研究所 マジセミ株式会社 |

|||||

|

|||||

|

|

|||||

|

マジセミは、今後も「参加者の役に立つ」ウェビナーを開催していきます。 過去セミナーの公開資料、他の募集中セミナーは▶こちらでご覧いただけます。 |

|||||

|

|||||

|

|||||

| https://www.youtube.com/watch?v=SufmqjROp0A | |||||

マジセミは、今後も「参加者の役に立つ」ウェビナーを開催していきます。