| 意味・解釈・判断停止(HOLD)・実行を分離し、制御可能な意思決定へ ― 本構想は、AI未導入の製造現場におけるPoCを通じて、実装・検証を進めていきます。 |

| 株式会社SHIRO & Co.(本社:東京都、代表:白子 孝介)は、AI時代における意思決定の構造的課題に対する答えとして、意思決定アーキテクチャ「Decision Stack(ディシジョン・スタック)」を発表します。 | ||||||||||||||

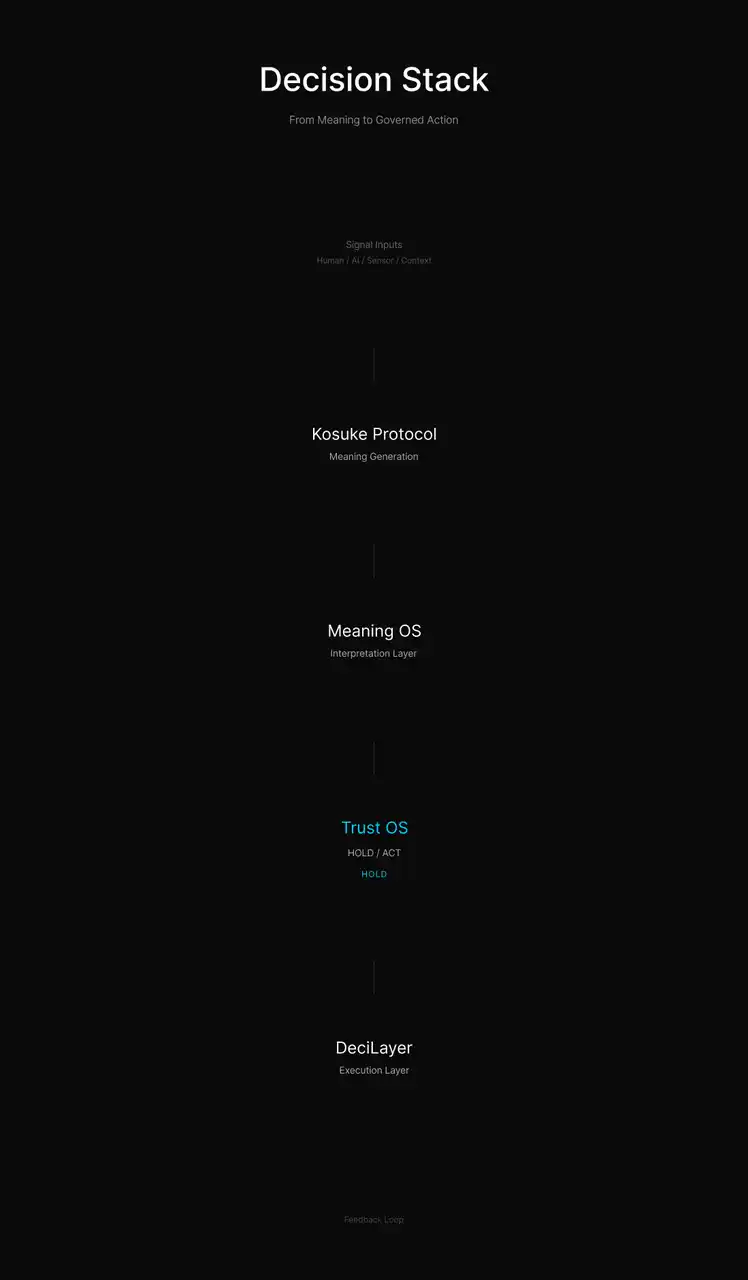

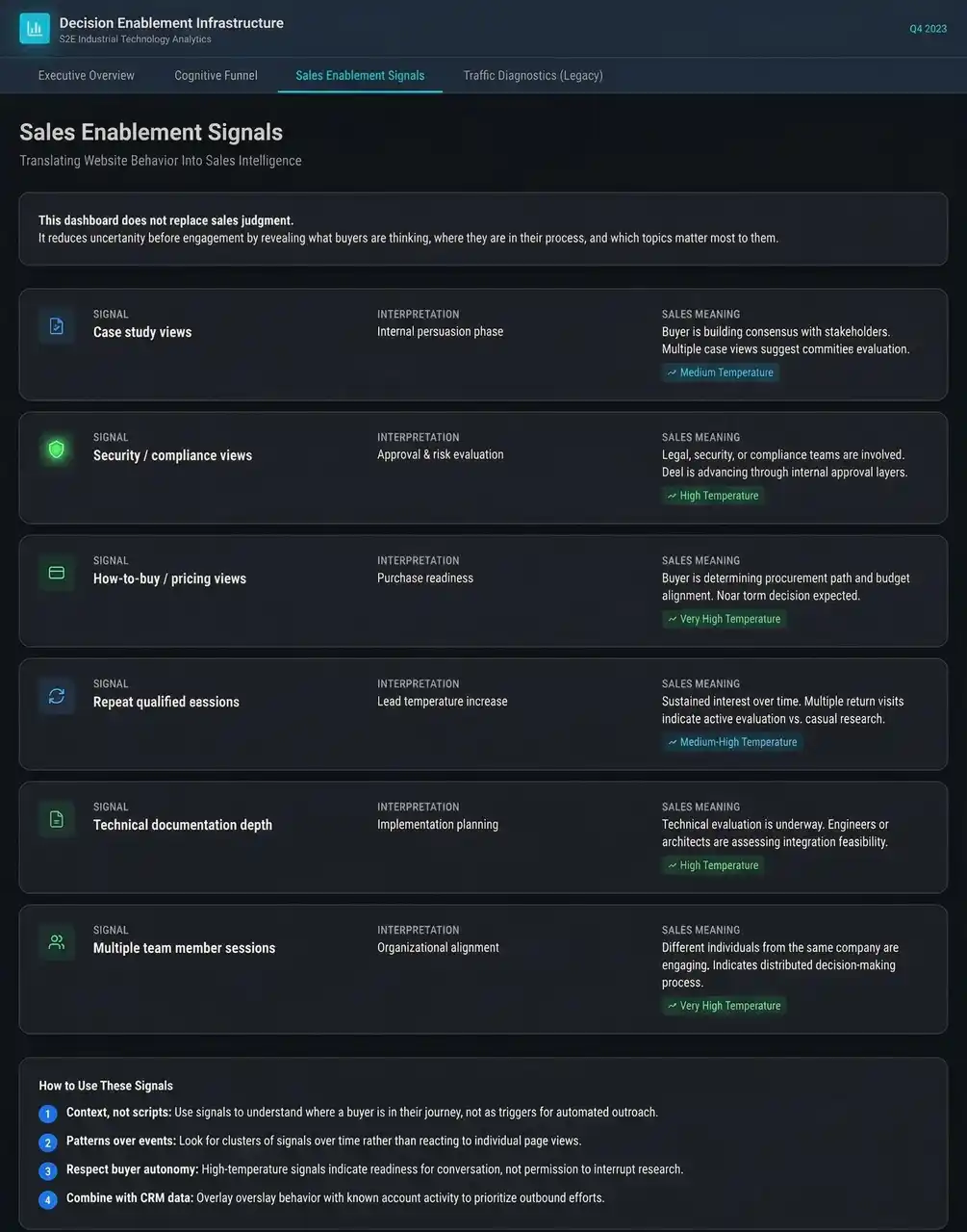

| 本アーキテクチャは、AIが直接「答え」を出力する従来モデルを見直し、意思決定を「生成物」ではなく「制御されるプロセス」として定義し直すものです。速さや正解率の議論では足りない「説明責任・監査・人間の最終判断」を、後付けではなく「設計の前提」に置きます。生成AIは下位の推論・生成エンジンとして位置づけ、その上位で意味・解釈・信頼制御・実行を分離する意思決定のスタックです。 | ||||||||||||||

|

■ AIの上位レイヤーとしての位置づけ Decision Stackは、単体のAIモデルやプロンプト設計の「延長」ではなく、「複数のAI・ルール・人間の判断を束ねる上位のアーキテクチャ」です。生成・推論は下位層(エンジン)として扱い、その出力に先立って、意味の候補化、文脈に応じた解釈の選択、リスクに応じた 「HOLD」、業務への実行までを「上位レイヤーで順に制御」します。「AIが何を言うか」より前に、「いつ・どの解釈で・実行するか/止めるか」を決める層が Decision Stack です。 |

||||||||||||||

| ■ 革新性とパラダイム | ||||||||||||||

| 本構想の革新性は、精度やプロンプトの改善といった「生成の微調整」ではありません。意味・解釈・信頼制御・実行を分離し、「実行しない」を失敗ではなく正規のアウトカムとして扱う--ここまで踏み込むことで、AIを「答え装置」から「止まれる・分岐できる・説明できる意思決定基盤」へ置き換えます。これは機能追加ではなく、「パラダイムの反転」です。 | ||||||||||||||

| ■ 特許・学術・先行事例との関係について | ||||||||||||||

| Decision Stackは既存の生成AIガバナンス、説明可能性(XAI)、RAGや人間協調の延長線上にある「改良」として位置づけるのではなく、「レイヤー責務とHOLDを中核に据えた独立した設計命題」として提示するものであり、出願・査読・産業界の先行実装との対照・差分は、今後の開示・論文化・実装の公開に合わせて順次、明確にしていく予定です。 | ||||||||||||||

| ■ ここが違う(3点) | ||||||||||||||

|

||||||||||||||

| ■ 従来型との対比(Input-Output モデルと Decision Stack) | ||||||||||||||

|

||||||||||||||

| ※上記は概念図として、意思決定を「一発の推論」から「運用可能なワークフロー」へ移すイメージを示すものです。 | ||||||||||||||

| ■ 背景:AIは意思決定を速くした。しかし、制御は十分ではありません | ||||||||||||||

| 生成AIと自律システムにより、意思決定はかつてない速度で出力されるようになりました。現場と規制が問うのは、もはや速さだけではありません。なぜそう結論したのか。どの前提で妥当なのか。いつ手を止めるべきか。ここに答えを持たない「速いAI」は、リスクを増幅し得ます。 | ||||||||||||||

| 多くのシステムは、次のような構造問題を抱えています。 | ||||||||||||||

|

||||||||||||||

| 従来は 「Input → Output」 に依存し、「意味」「解釈」「判断」「行動」が一体化しています。Decision Stackはこの一体化を切り離します。問いは「もっと正しい答えは何か」ではなく、「どのレイヤーで何を保留し、誰がどう承認するか」です。 | ||||||||||||||

| ■ Decision Stackとは | ||||||||||||||

| Decision Stackは、意思決定を4層に分離します。モジュール分割ではなく、責任境界の再設計です。 ここでいう各レイヤーは、いずれも単一モデルの内部処理ではなく、AIや業務システムより上位に置かれる制御・接続の責務として設計します。 | ||||||||||||||

|

||||||||||||||

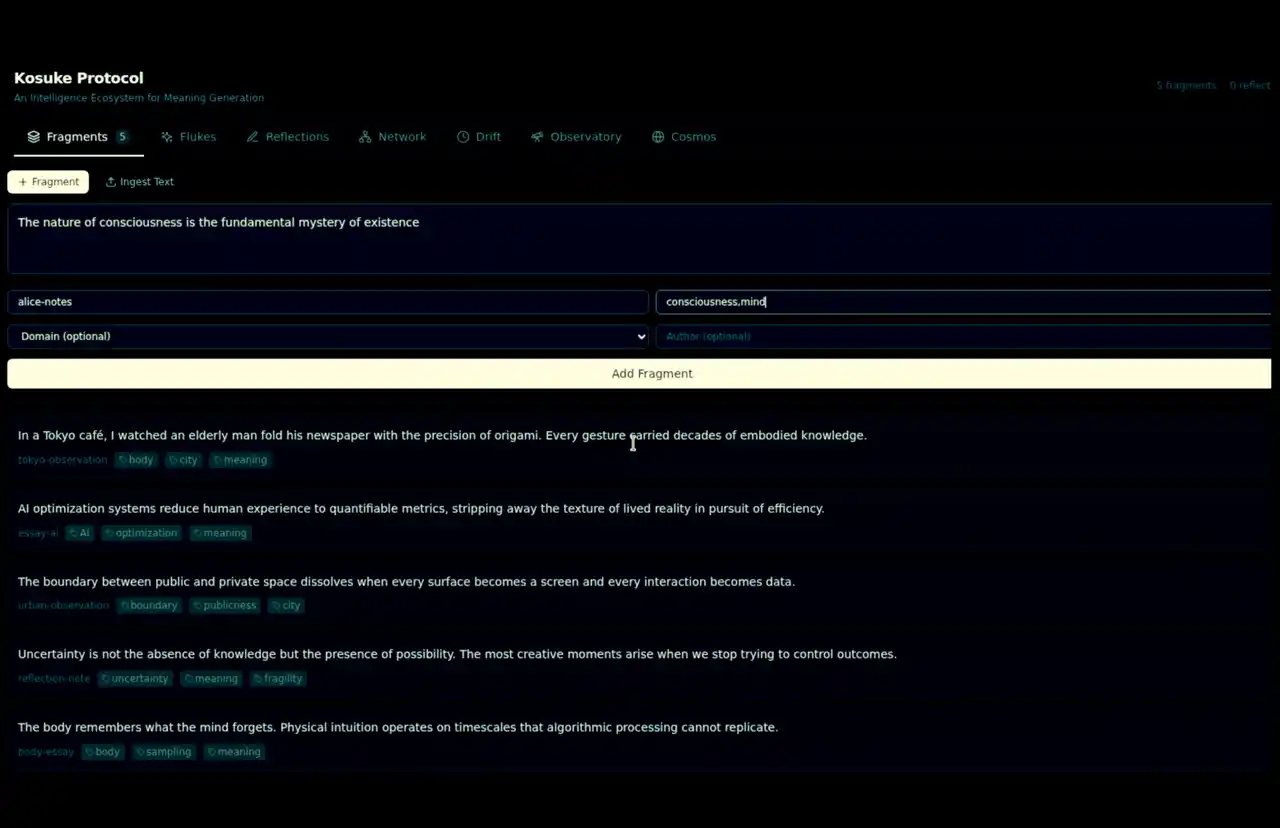

| Layer 1:Kosuke Protocol(意味生成層) | ||||||||||||||

| 複数の意味を生み出すネットワークです。「意味の集合」を扱い、早すぎる確定を避けます。一義的な「正解」への収束のみを前提とはしません。 | ||||||||||||||

|

||||||||||||||

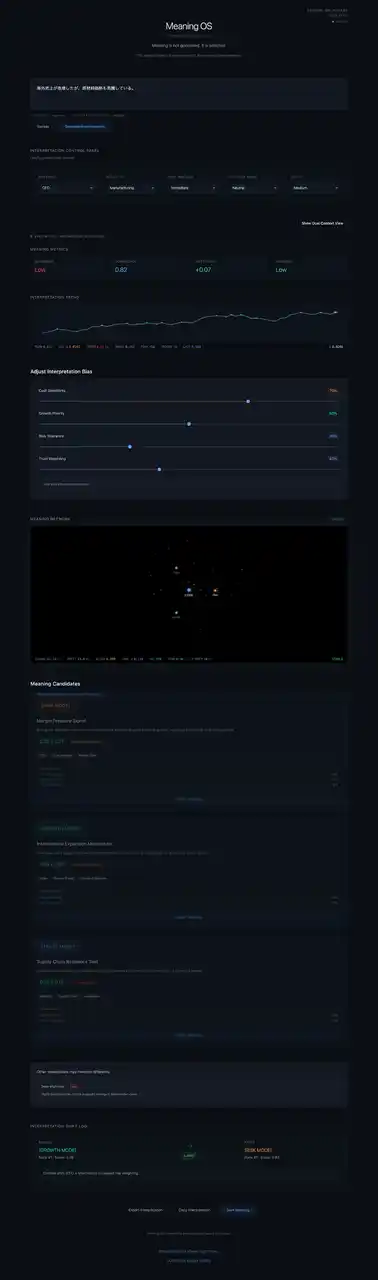

| Layer 2:Meaning OS(解釈層) | ||||||||||||||

| 文脈・立場・時間軸に応じて解釈を選びます。分岐を明示し、誰のための妥当性かをレイヤーで切り分けます。利害は後付けの説明ではなく分岐の入力として扱います。 | ||||||||||||||

|

||||||||||||||

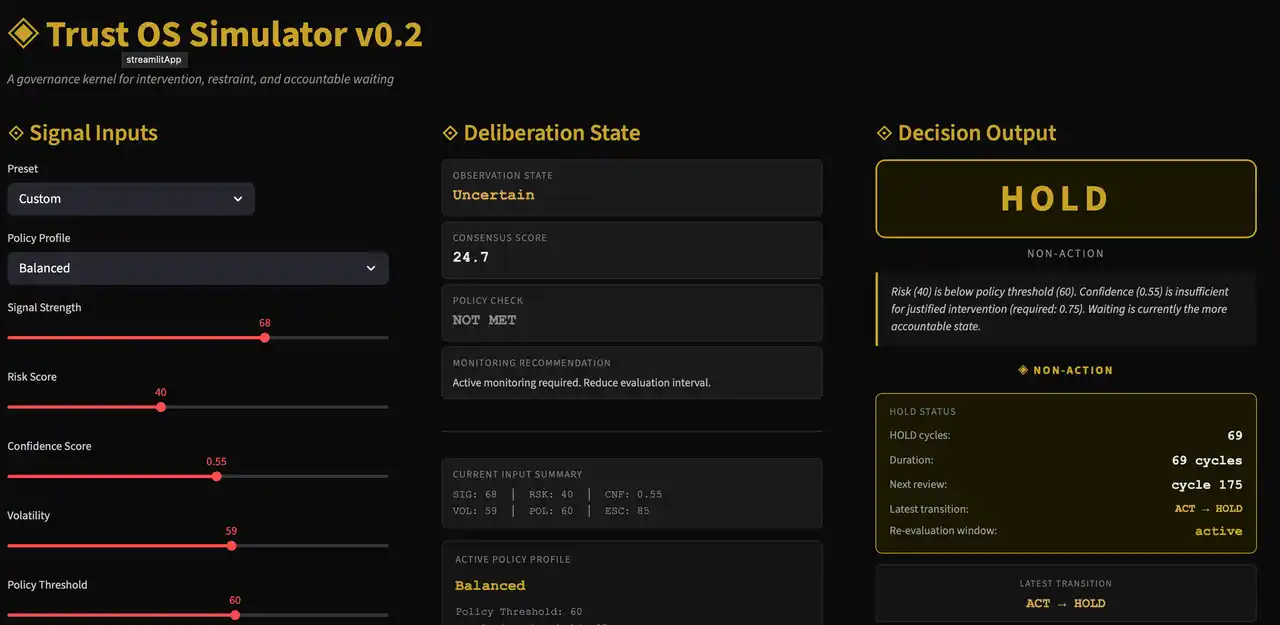

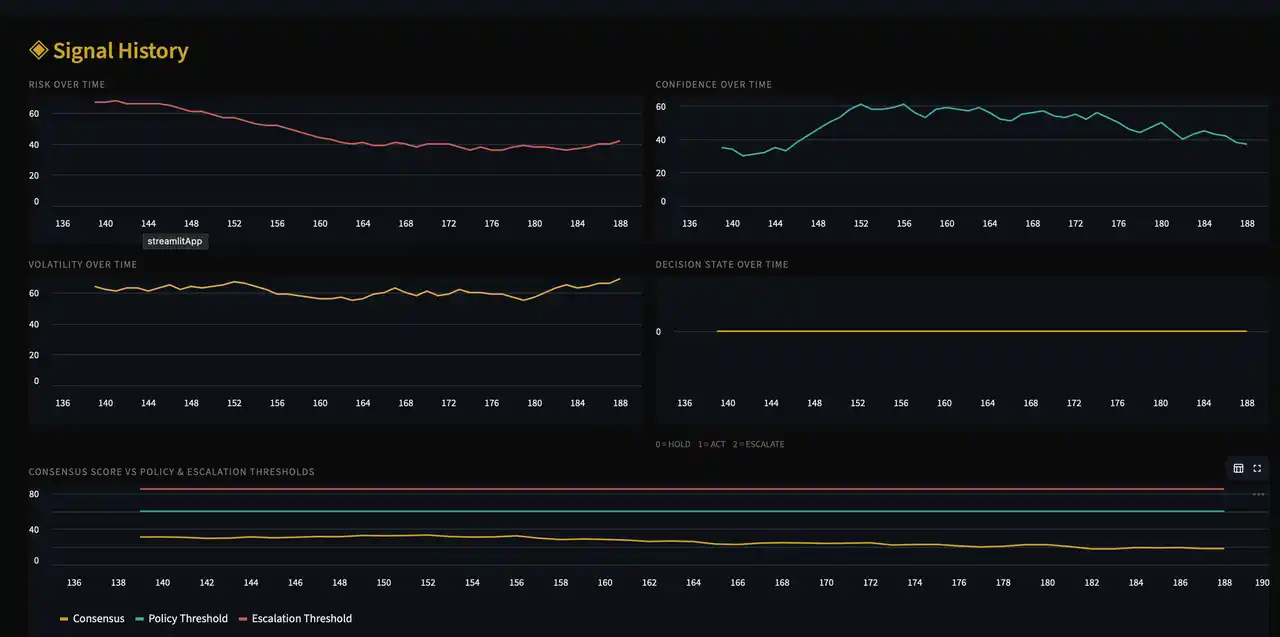

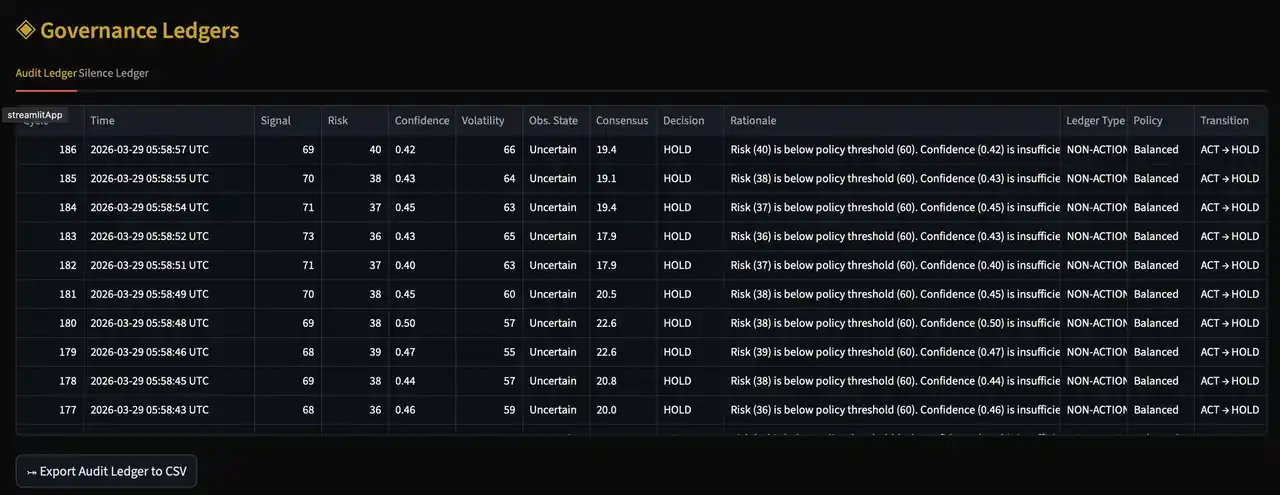

| Layer 3:Trust OS(制御層) | ||||||||||||||

| 実行か 「HOLD」 かを判断します。リスク・確信度・ポリシーに基づきガバナンスします。信頼をスコアだけで終えず、実行可否という行為に落とし込みます。 | ||||||||||||||

|

||||||||||||||

| Layer 4:DeciLayer(実行層) | ||||||||||||||

| CRM・営業・業務プロセスへ接続します。推論結果の単なる転記ではなく、承認・HOLD・実行の履歴を業務プロセスに接続します。 | ||||||||||||||

|

||||||||||||||

| ■ 最大の特徴:「HOLD」 | ||||||||||||||

| 中核となるのは HOLD(判断停止)です。 | ||||||||||||||

| 多くのAIは、入力に対し出力=行動を前提としがちです。Decision Stackはそれとは異なります。 | ||||||||||||||

|

||||||||||||||

| これは遅延の言い訳ではありません。「意図的に行動しない」という決定を、仕様に含めます。監査・教育・再現性のため、「止めた」事実と理由を「ログで残す」ことを前提とします。 | ||||||||||||||

| HOLDは安全の逃げ道にとどまりません。高リスク領域では「止まっている」ことが正規の運用状態になり得ます。そこが決定的に異なります。 | ||||||||||||||

| ■ 想定ユースケース:製造業・社会インフラ | ||||||||||||||

| 想定領域は次のとおりです。 | ||||||||||||||

|

||||||||||||||

| 例として、製造現場の工程判断(例:異常検知、作業分岐、品質判断)において、 | ||||||||||||||

|

||||||||||||||

| といった設計が可能です。設備異常の兆候、手順逸脱、サプライチェーン上の不確実性など、「誤実行コストが大きい局面」で、生成と実行の間に制御を置きます。「導入したからには自動で進める」という前提そのものを見直すことが、現場での活用につながります。 | ||||||||||||||

| ■ 今後の展開 | ||||||||||||||

|

||||||||||||||

| ■ PoCの想定スコープ(例) | ||||||||||||||

| 異常検知や作業指示の分岐など、AIの提案 → 人の承認 → 現場実行が連続するプロセスを起点に、Trust OSのHOLD条件とDeciLayerによる業務連携の一部を検証する想定です(詳細は個別協議のうえ調整いたします)。 | ||||||||||||||

| ■ 代表コメント | ||||||||||||||

| AIは意思決定を生成できるようになりました。しかし、それを制御する構造は、まだ十分にはありません。Decision Stackは、「止める」ことを設計に含めるアーキテクチャです。これから必要なのは速さだけではありません。「どこで止まれるか」、その設計だと考えています。 | ||||||||||||||

| ■ 会社概要 | ||||||||||||||

| 会社名:株式会社SHIRO & Co. | ||||||||||||||

| 所在地:東京都 | ||||||||||||||

| 事業内容:ブランド戦略、意思決定設計、プロダクト開発 | ||||||||||||||

■ 背景:AIは意思決定を速くした。しかし、制御は十分ではありません

なぜそう結論したのか。どの前提で妥当なのか。いつ手を止めるべきか。ここに答えを持たない「速いAI」は、リスクを増幅し得ます。